Đại học Western Sydney đang phát triển một siêu máy tính hình thái thần kinh.

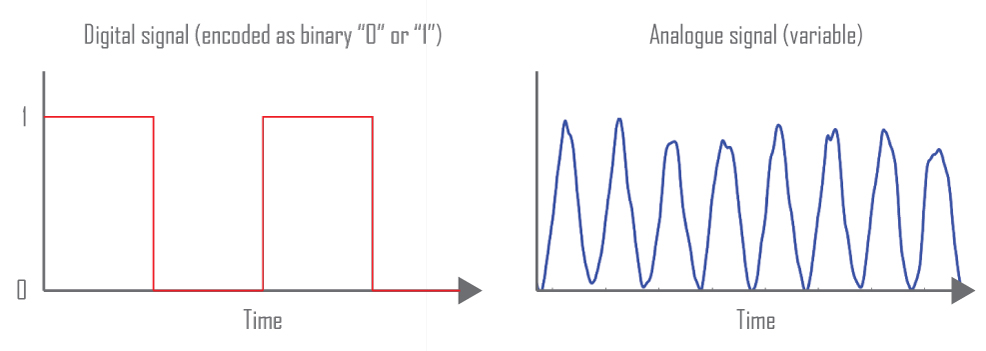

Cỗ máy này sẽ mô phỏng các quá trình sinh học để mô phỏng các mạng lưới lớn các tế bào thần kinh phát xung với tốc độ 228 nghìn tỷ hoạt động synap mỗi giây – có khả năng sánh ngang với não người. Nguồn: Đại học Western Sydney Máy tính hình thái thần kinh là một phương pháp tiếp cận đầy hứa hẹn đối với trí tuệ nhân tạo (AI). Bằng cách xử lý thông tin hiệu quả hơn, nó tìm cách thu hẹp khoảng cách giữa các kiến trúc máy tính truyền thống và các mạng lưới thần kinh phức tạp hơn nhiều được tìm thấy trong não sinh học sống. Nhà khoa học người Mỹ Carver Mead đã phổ biến thuật ngữ Định luật Moore, nhưng ông cũng được biết đến là người tiên phong trong lĩnh vực kỹ thuật hình thái thần kinh. Ông và các đồng nghiệp tại Viện Công nghệ California đã thiết kế những ví dụ đầu tiên được biết đến về chip hình thái thần kinh vào những năm 1980. Trong thời gian đó, Mead cũng đã phát triển võng mạc silicon và ốc tai silicon đầu tiên, có khả năng mô phỏng quá trình xử lý thông tin thị giác và thính giác. Công trình của ông đã mở đường cho các con chip tiên tiến hơn vào những năm 1990 trở đi, với những cải tiến về khả năng theo cấp số nhân. Về cơ bản, chip neuromorphic hoạt động bằng cách mô phỏng bố cục và hành động vật lý của mạng nơ-ron sinh học. Máy tính truyền thống bị giới hạn ở việc gửi và nhận dữ liệu nhị phân (0 và 1) thông qua một đơn vị xử lý tập trung (CPU). Ngược lại, máy tính neuromorphic năng động hơn nhiều – có thể làm việc với thông tin theo cách song song, phi tập trung – và kết hợp cả mạch tương tự và mạch kỹ thuật số. Điều này có nghĩa là chúng có thể xử lý dữ liệu ở nhiều trạng thái và phạm vi thời gian khác nhau.

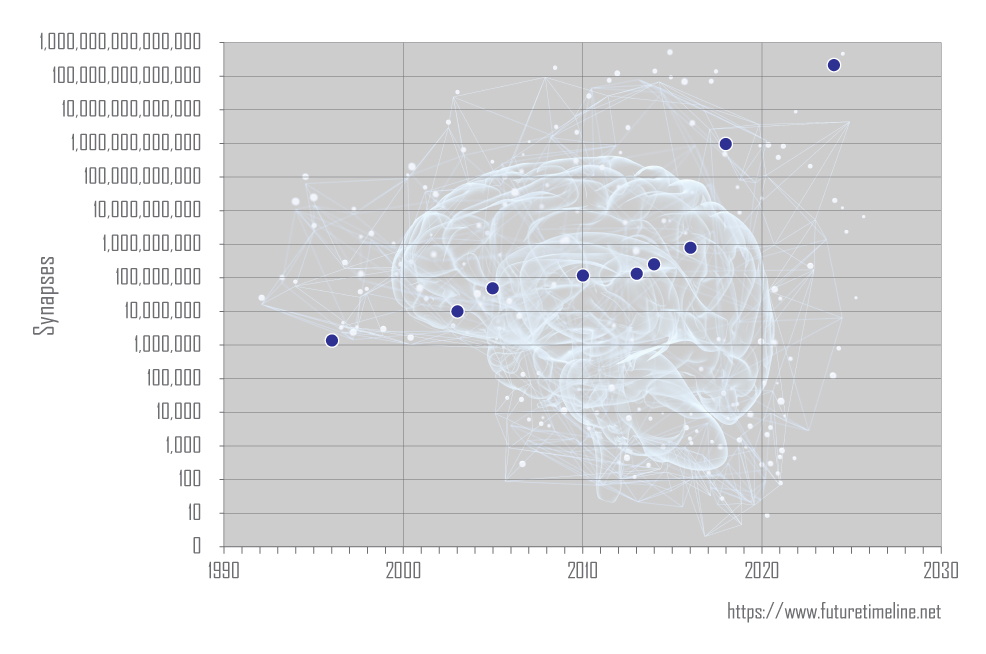

Cái gọi là Mạng nơ-ron gai do các hệ thống này tạo ra có thể mô hình hóa các mẫu không gian-thời gian phức tạp, cung cấp thêm một chiều cho dữ liệu, ngoài các trạng thái nhị phân đơn thuần. Vì kiến trúc của chúng rất giống với nơ-ron và khớp thần kinh, nên máy tính neuromorphic cực kỳ phù hợp cho các nhiệm vụ như nhận dạng mẫu, ra quyết định và xử lý dữ liệu cảm biến. Chúng có thể học và thích ứng theo thời gian thực, sắp xếp lại các kết nối khớp thần kinh của chúng dựa trên các mẫu đầu vào mới. Trong những năm gần đây, số lượng khớp thần kinh có sẵn trong các hệ thống này đã tăng nhanh chóng, tương đương với các loài động vật như chuột thường (125 tỷ) và chuột cống (500 tỷ). Một bước tiến lớn đã diễn ra vào năm 2018, khi các nhà nghiên cứu Vương quốc Anh phát triển SpiNNaker, có thể sao chép tương đương 1% bộ não người. Như thường lệ với các công nghệ theo cấp số nhân (biểu đồ bên dưới sử dụng thang logarit cho trục y của nó), một bước nhảy vọt khác về khả năng đã được báo cáo. Tuần này, các kỹ sư tại Đại học Western Sydney, Úc, đã tiết lộ kế hoạch cho một siêu máy tính hình thái thần kinh có tên là DeepSouth sẽ có 228 nghìn tỷ hoạt động khớp thần kinh mỗi giây gần như không thể tưởng tượng được.

Nói cách khác, đây có thể là hệ thống đầu tiên cùng loại có thể khớp với số lượng khớp thần kinh trong não người. Giáo sư Kỹ thuật Điện André van Schaik cho biết trong một thông cáo báo chí từ Đại học Western Sydney: "Tiến độ hiểu biết của chúng ta về cách não bộ tính toán bằng cách sử dụng tế bào thần kinh bị cản trở do chúng ta không thể mô phỏng các mạng lưới giống não ở quy mô lớn". "Mô phỏng mạng nơ-ron thần kinh phát xung trên máy tính tiêu chuẩn bằng Bộ xử lý đồ họa (GPU) và Bộ xử lý trung tâm (CPU) đa lõi quá chậm và tốn nhiều điện năng. Hệ thống của chúng tôi sẽ thay đổi điều đó. "Nền tảng này sẽ thúc đẩy sự hiểu biết của chúng ta về não bộ và phát triển các ứng dụng điện toán quy mô não bộ trong nhiều lĩnh vực khác nhau bao gồm cảm biến, y sinh, rô-bốt, không gian và các ứng dụng AI quy mô lớn". Hiệu quả năng lượng sẽ là trọng tâm chính của dự án DeepSouth, theo những người sáng tạo ra nó. Mặc dù không thể sớm đạt được mức tiêu thụ điện năng cực nhỏ của não người chỉ 20 watt - chỉ đủ cho một bóng đèn thông thường - nhưng nhóm nghiên cứu tại Western hy vọng sẽ chứng minh được sự cải thiện đáng kể so với những nỗ lực trước đây. Nó cũng sẽ nhỏ hơn nhiều so với các siêu máy tính khác.

Họ có kế hoạch đưa nó vào hoạt động vào tháng 4 năm 2024. Tuy nhiên, các nhà khoa học vẫn đang tranh luận về số lượng khớp thần kinh thực tế trong não người, do đó, tuyên bố của trường đại học về một cỗ máy "quy mô não bộ" vẫn chưa rõ ràng. Các ước tính hiện tại dao động từ 100 nghìn tỷ đến 1 nghìn tỷ, minh họa cho sự phức tạp và biến đổi to lớn của các kết nối thần kinh. Cũng giống như việc cố gắng đếm số lượng các ngôi sao trong một thiên hà hoặc các thiên hà trong vũ trụ của chúng ta, những con số này có thể được điều chỉnh khi các công nghệ hình ảnh và phương pháp nghiên cứu mới xuất hiện. Bất kể con số chính xác là bao nhiêu, khả năng của DeepSouth có thể được cho là nằm trong phạm vi "quy mô não", lần đầu tiên một máy tính hình thái thần kinh có thể mô phỏng được sự phức tạp sinh học như vậy. Cho dù đạt được bởi DeepSouth hay một hệ thống cạnh tranh trong vài năm tới, thì cột mốc này cũng gần như phù hợp với dự đoán về mốc thời gian của chúng tôi cho năm 2025.

Western Sydney University is developing a neuromorphic supercomputer. The machine will mimic biological processes to emulate large networks of spiking neurons at 228 trillion synaptic operations per second – potentially rivalling the human brain.

Credit: Western Sydney University

Neuromorphic computing is a highly promising approach to artificial intelligence (AI). By processing information more efficiently, it seeks to bridge the gap between traditional computer architectures and the far more complex neural networks found in living, biological brains.

American scientist Carver Mead popularised the term Moore's Law, but he is also known for pioneering the field of neuromorphic engineering. He and colleagues at the California Institute of Technology designed the first known examples of neuromorphic chips in the 1980s. During that time, Mead also developed the first silicon retinas and silicon cochleas, able to emulate the processing of visual and auditory information. His work paved the way to more advanced chips in the 1990s and beyond, featuring orders of magnitude improvements in capability.

Essentially, neuromorphic chips work by mimicking the layout and physical actions of biological neural networks. Traditional computers are limited to the sending and receiving of binary data (0s and 1s) through a centralised processing unit (CPU). By contrast, neuromorphic computers are much more dynamic – able to work with information in a parallel, decentralised manner – and combining both analogue and digital circuits. This means they can handle data of varying states and time ranges. The so-called Spiking Neural Networks generated by these systems are able to model complex spatio-temporal patterns, providing an additional dimension to the data, beyond mere binary states.

Because their architecture is so similar to neurons and synapses, neuromorphic computers are extremely well-suited for tasks such as pattern recognition, decision making, and sensory data processing. They can learn and adapt in real-time, rearranging their synaptic connections based on new input patterns.

In recent years, the number of synapses available in these systems has crept rapidly upwards, matching animal species such as the common mouse (125 billion) and rat (500 billion). A major advance occurred in 2018, as UK researchers developed SpiNNaker, which could replicate the equivalent of 1% of the human brain.

As is often the case with exponential technologies (the graph below uses a logarithmic scale for its y-axis), another orders-of-magnitude jump in capability has now been reported. This week, engineers at the Western Sydney University, Australia, revealed plans for a neuromorphic supercomputer called DeepSouth that will feature an almost unimaginable 228 trillion synaptic operations per second. In other words, it could be the first system of its kind to match the number of synapses in the human brain.

"Progress in our understanding of how brains compute using neurons is hampered by our inability to simulate brain-like networks at scale," said Professor of Electrical Engineering, André van Schaik, in a news release from Western Sydney University. "Simulating spiking neural networks on standard computers using Graphics Processing Units (GPUs) and multicore Central Processing Units (CPUs) is just too slow and power intensive. Our system will change that.

"This platform will progress our understanding of the brain and develop brain-scale computing applications in diverse fields including sensing, biomedical, robotics, space, and large-scale AI applications."

Energy efficiency will be a key focus of the DeepSouth project, according to its creators. Although matching the human brain's miniscule power consumption of just 20 watts – barely enough for a typical lightbulb – won't be possible anytime soon, the team at Western hopes to demonstrate a significant improvement compared to previous efforts. It will also be much smaller than other supercomputers. They plan to make it operational by April 2024.

However, there is ongoing debate among scientists over the actual number of synapses in the human brain, so the university's claim of a "brain-scale" machine is somewhat unclear. Current estimates range from 100 trillion to 1 quadrillion, illustrating the vast complexity and variability of neural connections. Rather like attempting to count the number of stars in a galaxy, or the galaxies in our universe, these figures can be subject to revision as new imaging technologies and research methodologies emerge.

Regardless of the precise number, DeepSouth's capabilities will arguably fall within the ballpark of "brain scale", the first time a neuromorphic computer has been able to mimic such biological complexity. Whether achieved by DeepSouth, or a competing system in the next few years, this milestone roughly aligns with our timeline prediction for 2025.

By FutureTimeLine